Investigadores de la Universidad Pontificia de Salamanca han desarrollado una aplicación que permite a los ciegos escribir en pantallas táctiles

Desde que los teléfonos móviles han dejado de incorporar teclado y solamente tienen una pantalla táctil, un sector de la sociedad se ha visto gravemente perjudicado, las personas invidentes. Gracias a Roberto Vega y Abel Prieto, dos investigadores de la Universidad Pontificia de Salamanca, ahora podrán comenzar también a utilizar estos móviles de última generación.

Los dos jóvenes informáticos, bajo la supervisión de Javier Bajo, han ideado la aplicación llamada “EyeTouch” que incorpora el teclado braille al teléfono móvil, permitiendo a los invidentes ampliar un uso hasta ahora muy limitado. Este es el primer paso de un proyecto más ambicioso que acaba de entrar en la segunda fase, disponible para Windows Phone pero que se adaptará en breve a Android y Apple.

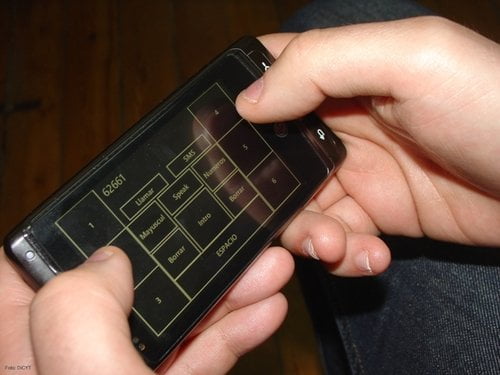

La idea es transformar, con puntos de presión, un plástico protector de manera que el usuario invidente, sólo pasando los dedos pueda identificar los botones en braille. Dicho de otra manera, el plástico vendrá diseñado de tal manera que tendrá unos relieves. Así, el invidente al pasar los dedos podrá “ver” lo que pulsa y la función que tiene.

Para conseguir esto, Abel explica que «al final apostamos por una empresa que hace plantillas de plástico, para que nos haga una adhesiva con el relieve suficiente para poder escribir en braille. De esa forma solventamos el problema».

Abel explica a los medios de prensa cómo desarrollaron el teclado braille: «Dividimos los laterales de la pantalla en cuadrados, porque el braille se escribe combinando dos columnas de tres puntos. El centro es para el ‘intro’, pero también hay las opciones de borrar o que el teléfono pronuncie lo escrito para confirmar que es correcto».

«Con un teclado consigues todo. La persona invidente ya puede agregar contactos o escribir mensajes de texto. Hasta ahora era casi imposible que pudieran hacerlo con un teléfono táctil».

Complementado con instrucciones por voz

Una persona con dificultades visuales gracias a su sistema de voz puede enterarse de lo que escribe, de hecho, existen en el mercado otras aplicaciones que dicen al usuario el lugar exacto sobre el que tiene su dedo. Es decir, que puede pronunciar la letra exacta sobre la que tiene el dedo pero no identifica de ninguna forma física su ubicación en la pantalla, lo que alarga el tiempo de escribir de forma innecesaria.

La aplicación EyeTouch está programada para conectarse a un servidor de Microsoft Speech, que recoge texto, y lo de vuelve en voz de una manera precisa y de claridad. Por lo que, esta persona será capaz sin necesidad de ver, escribir mensajes, llamar por teléfono.

La aplicación funciona de la siguiente manera:

- El usuario introduce un texto.

- Verifica el texto pulsado el botón ‘Speech’.

- La aplicación enviará ese texto a un servidor externo. Entonces, devuelve eso mismo convertido en voz.

- Una vez verificado pulsamos ‘Llamar’ o ‘SMS’.

Los jóvenes reconocen que ahora mismo la aplicación es sencilla, pero ya tienen pensados los siguientes pasos. «Ahora ya se pueden hacer llamadas y escribir mensajes, pero con este tipo de teclado se puede desarrollar lo que nos de la gana. Desde pedir que busque una canción en el teléfono móvil o que navegue en internet, que deje comentarios en Facebook… las opciones son enormes», asegura Abel.

Resultados positivos

Tras las pruebas que han realizado, los resultados han sido los esperados. Tanto en la fase de análisis como la prueba final del proceso. El proyecto ha sido complicado desde el principio, con lo que ha implicado una toma de decisiones para resolver la solución final y convertir algo ideal en algo físico.

Los desarrolladores del mismo explican en la Web del Club de Innovación de la UPSA lo siguiente:

- Se integró el estudio del lenguaje de programación C#, con la cualidad de que era un lenguaje orientado a objetos (LOO), muy similar a JAVA, en la mayoría de los aspectos y que ha facilitado el proceso.

- Una vez dominado el curso, se implementó el teclado tanto con el diseño gráfico como el código pertinente. Nos dimos cuenta que simplemente, era un método capturador de eventos que pudiera identificar las pulsaciones. Con estos eventos, eran los que utilizábamos para crear la salida. Como cada letra en Braille es un símbolo único, conseguir una estructura de datos es trivial, el diccionario, es la estructura elegida y contendría todos los códigos asociados a un símbolo.

- Obtenido el símbolo, el teclado es trivial. Sencillamente, es una combinación de números que pulsado en un orden da la salida pertinente. Las pruebas demostraron que el funcionamiento táctil es perfecto.

- Los servicios a Internet duplicaban la potencia de la aplicación. Tanto en 3G como en Wi-Fi, eran conexiones suficiente para obtener el audio que leería el texto.

- Si el texto es correcto y encima el dictado no contiene errores, el programa da dos opciones; llamar o enviar un sms. Ambas funciones del sistema del móvil, se acceden de manera directa, por ejemplo, si quieres llamar almacenas el número, creas el evento y lo lanzas.

- Contábamos con la ayuda de la Organización de la ONCE para hacer test reales con invidentes reales.

Por último, afirman algo muy digno de su labor y que ejemplifica el enfoque humano del proyecto:

El desarrollo de aplicaciones que ayudan o facilitan la vida a las personas, es un hecho que honra y gratifica a la gente. Por eso, los resultados obtenidos son satisfactorios por varias razones; aprender a abrir la mente, desarrollar un diseños específicos, materializar una idea, aprender lenguajes de programación, metodologías. Todo esto ayudará a ampliar currículo y abrir nuevos caminos para el futuro.

Más información en la Web del Proyecto EyeTouch de la Universidad Pontificia de Salamanca.